Onderzoekers aan het Massachusetts Institute of Technology (MIT) hebben een techniek ontwikkeld waarmee een robot een nieuwe pick-and-place-taak kan leren met slechts een handvol menselijke demonstraties.

Stel een magazijnrobot pakt mokken van een plank of band en plaatst ze in dozen voor verzending. Alles gaat goed totdat het magazijn een wijziging verwerkt en de robot hogere, smallere mokken moet grijpen die ondersteboven worden bewaard. Voor het met AI herprogrammeren van de robot moeten duizenden afbeeldingen met de hand worden gelabeld om te laten zien hoe deze nieuwe mokken moeten worden vastgepakt. Vervolgens moet het systeem opnieuw worden getraind.

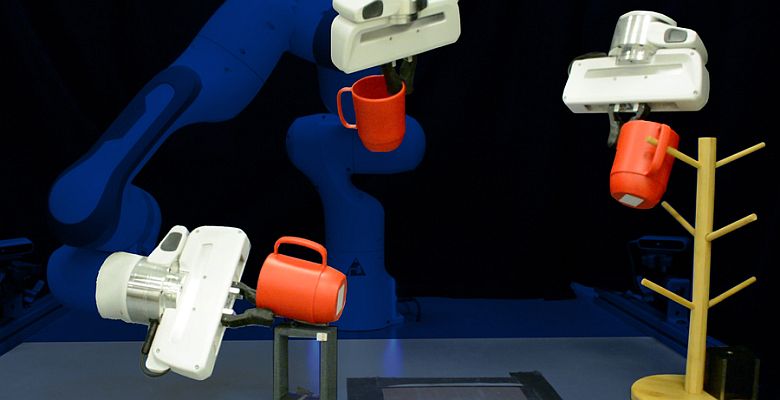

Een nieuwe techniek ontwikkeld door onderzoekers van het MIT zou slechts een handvol menselijke demonstraties vereisen om de robot te herprogrammeren. Dankzij deze machine learning methode kan een robot nooit eerder vertoonde objecten oppakken en in willekeurige poses plaatsen. Binnen tien tot vijftien minuten zou de robot klaar zijn om een nieuwe pick-and-place taak uit te voeren.

Neuraal netwerk

De techniek maakt gebruik van een neuraal netwerk dat speciaal is ontworpen om de vormen van 3D-objecten te reconstrueren. Met slechts een paar demonstraties gebruikt het systeem wat het neurale netwerk heeft geleerd over 3D-geometrie om nieuwe objecten te begrijpen die vergelijkbaar zijn met die in de demo's.

In simulaties en met behulp van een echte robotarm lieten de onderzoekers zien dat hun systeem nooit eerder vertoonde mokken, kommen en flessen effectief kan manipuleren. Hij rangschikt de objecten in willekeurige poses, met slechts tien demonstraties om de robot te onderwijzen.

De belangrijkste bijdrage van de onderzoekers is het algemene vermogen om veel efficiënter nieuwe vaardigheden te bieden aan robots die moeten werken in ongestructureerde omgevingen waar veel variabiliteit kan zijn. Het concept van generalisatie door constructie is een fascinerende mogelijkheid omdat dit probleem doorgaans zoveel moeilijker is.

Grijpgeometrie

Een robot is doorgaans getraind om een specifiek item op te pakken. Maar als dat object op zijn kant ligt (misschien is het omgevallen), ziet de robot dit als een compleet nieuw scenario. Dit is een van de redenen waarom het voor machine learning-systemen zo moeilijk is om te generaliseren naar nieuwe objectoriëntaties.

Om deze uitdaging te overwinnen, creëerden de onderzoekers een nieuw type neuraal netwerkmodel, een Neural Descriptor Field (NDF), dat de 3D-geometrie van een klasse items leert. Het model berekent de geometrische weergave voor een specifiek item met behulp van een 3D-puntenwolk, een set gegevenspunten of coördinaten in drie dimensies.

De datapunten kunnen worden verkregen uit een dieptecamera die informatie geeft over de afstand tussen het object en een gezichtspunt. Hoewel het netwerk is getraind in simulatie op een grote dataset van synthetische 3D-vormen, kan het direct worden toegepast op objecten in de echte wereld.

Equivalentie

Het onderzoeksteam ontwierp de NDF met een eigenschap die equivalentie wordt genoemd. Met deze eigenschap – als het model een afbeelding van een rechtopstaande mok te zien krijgt en vervolgens een afbeelding van dezelfde mok op zijn zijkant – begrijpt het dat de tweede mok hetzelfde object is, alleen gedraaid. Met deze equivalentie kunnen de onderzoekers effectiever omgaan met gevallen waarin het object zich in een willekeurige oriëntatie bevindt.

Terwijl de NDF leert vormen van vergelijkbare objecten te reconstrueren, leert het ook verwante delen van die objecten te associëren. Het leert bijvoorbeeld dat de handvatten van mokken vergelijkbaar zijn, zelfs als sommige mokken groter of breder zijn dan andere, of kleinere of langere handvatten hebben.

Met dit getrainde NDF-model leren de onderzoekers een robot een nieuwe vaardigheid met slechts een paar fysieke voorbeelden. Ze verplaatsen de hand van de robot naar het deel van een object dat ze willen vastpakken, zoals de rand van een kom of het handvat van een mok, en registreren de locaties van de vingertoppen. Omdat de NDF zoveel heeft geleerd over 3D-geometrie en hoe vormen te reconstrueren, kan het de structuur van een nieuwe vorm afleiden, waardoor het systeem de demonstraties kan overbrengen naar nieuwe objecten in willekeurige poses.

Succespercentage

De onderzoekers testten hun model in simulaties en op een echte robotarm met mokken, kommen en flessen als objecten. Hun methode had een succespercentage van 85% bij pick and place taken met nieuwe objecten in nieuwe oriëntaties. De beste bestaande oplossing kon slechts een succespercentage van 45% behalen. Succes betekent hier: een nieuw object pakken en op een doellocatie plaatsen, zoals mokken op een rek hangen.

Veel oplossingen gebruiken 2D-beeldinformatie in plaats van 3D-geometrie, wat het voor deze methoden moeilijker maakt om equivalentie te integreren. Hoewel de onderzoekers tevreden waren met de prestaties, werkt hun methode alleen voor de specifieke objectcategorie waarop deze is getraind. Een robot die is geleerd om mokken op te pakken, kan geen dozen of koptelefoons oppakken. Deze objecten hebben geometrische kenmerken die te veel verschillen van die waarop het netwerk is getraind.

In de toekomst zou het ideaal zijn om het op te schalen naar veel categorieën of het idee van categorie helemaal los te laten. De onderzoekers willen het systeem aanpassen voor niet-rigide objecten. Op de langere termijn willen ze het systeem leren pick and place taken uit te voeren wanneer het doelgebied verandert.

Foto: MIT