Amerikaanse onderzoekers hebben een lokaal leernetwerk gecreëerd dat snel, zuinig met energie en schaalbaar is.

Wetenschappers komen veel afwegingen tegen bij het bouwen en opschalen van hersenachtige systemen die machine learning kunnen uitvoeren. Neurale netwerken kunnen bijvoorbeeld taal- en visieon-taken leren, maar het proces van het trainen van computers om deze taken uit te voeren is traag en vereist veel kracht.

Door machines te trainen om digitaal te leren maar taken analoog uit te voeren (wat betekent dat de invoer varieert met een fysieke grootheid, zoals spanning), kunnen tijd en vermogen worden verminderd. Maar kleine fouten kunnen zich snel verergeren. Een elektrisch netwerk dat onderzoekers van de University of Pennsylvania in Philadelphia eerder hebben ontworpen, is schaalbaarder. Fouten vermenigvuldigen zich hierin niet op dezelfde manier naarmate de omvang van het systeem groeit. Maar het is beperkt omdat het alleen lineaire taken kan leren, met een eenvoudige relatie tussen de invoer en de uitvoer.

Analoog systeem

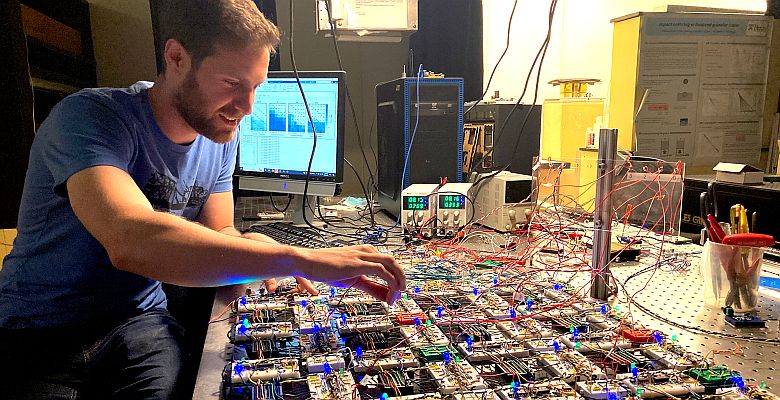

De onderzoekers hebben nu een analoog systeem gecreëerd dat snel, energiezuinig en schaalbaar is. Ook kan het complexere taken kan leren, waaronder 'exclusive of' relaties (XOR) en niet-lineaire regressie. Dit wordt een contrastief lokaal leernetwerk genoemd: de componenten evolueren vanzelf op basis van lokale regels zonder kennis van de grotere structuur. Het is te vergelijken met neuronen in het menselijk brein die niet weten wat andere neuronen doen, maar toch leren. Het kan leren, in de zin van machine learning, om nuttige taken uit te voeren. Het is vergelijkbaar met een neuraal netwerk op computers, maar het is een fysiek object.

Omdat het systeem geen kennis heeft van de structuur van het netwerk, is het tolerant voor fouten en kan het op verschillende manieren worden gemaakt. Dit biedt volgens de onderzoekers veel mogelijkheden om op te schalen. Ze zien het als een modelsysteem dat ze kunnen bestuderen om inzicht te krijgen in allerlei problemen, ook biologische problemen. Dat kan ook nuttig zijn bij de koppeling met apparaten die gegevens verzamelen die moeten worden verwerkt, zoals camera's en microfoons.

Volgens de auteurs biedt het zelflerende systeem een kans om emergent learning (opkomend leren) te bestuderen. In vergelijking met biologische systemen, inclusief de hersenen, vertrouwt het systeem op een eenvoudigere, goed begrepen dynamiek. Het is nauwkeurig te trainen en maakt gebruik van eenvoudige modulaire componenten.

Vertaling

Het onderzoek is gebaseerd op het Coupled Learning framework waarover in 2021 is gepubliceerd. In dit paradigma past een fysiek systeem dat niet is ontworpen om een bepaalde taak te volbrengen zich aan aan toegepaste input om de taak te leren. Daarbij worden lokale leerregels gebruikt en geen gecentraliseerde processor.

De onderzoekers hebben gewerkt aan de vertaling van het raamwerk van werken in simulatie naar werken in het huidige fysieke ontwerp, dat kan worden gemaakt met behulp van standaard schakelcomponenten. Een van de gekste aspecten is dat het systeem eigenlijk vanzelf leert; de onderzoekers zijn het gewoon aan het voorbereiden. Ze voeren alleen spanningen in als input; vervolgens passen de transistors die de knooppunten verbinden hun eigenschappen aan op basis van de Coupled Learning regel.

“Omdat de manier waarop het systeem zowel berekent als leert is gebaseerd op natuurkunde, is het veel interpreteerbaar. De onderzoekers kunnen er achter komen wat het probeert te doen, omdat ze het onderliggende mechanisme goed onder de knie hebben. Veel andere leersystemen daarentegen zijn black boxes, waarbij het veel moeilijker is om te weten waarom het netwerk deed wat het deed.

Vervolg

De onderzoekers werken momenteel aan het opschalen van het ontwerp. Er zijn nog veel vragen over de duur van de geheugenopslag, de effecten van ruis, de beste architectuur voor het netwerk. Ook willen ze weten of er betere vormen van niet-lineariteit zijn. Het is niet echt duidelijk wat er verandert als ze een leersysteem opschalen. Denkend aan een brein is er een grote kloof tussen een worm met 300 neuronen en een mens. Het is niet duidelijk waar die vermogens naar voren komen, hoe dingen veranderen naarmate iets groter wordt. Het hebben van een fysiek systeem dat groter en groter en groter en groter is te maken, is een kans om dat daadwerkelijk te bestuderen.

De wetenschappelijke publicatie vindt u hier.

Foto: Erica Moser