Een algoritme voor mensbewuste bewegingsplanning zorgt voor veilige samenwerking tussen robot en mens.

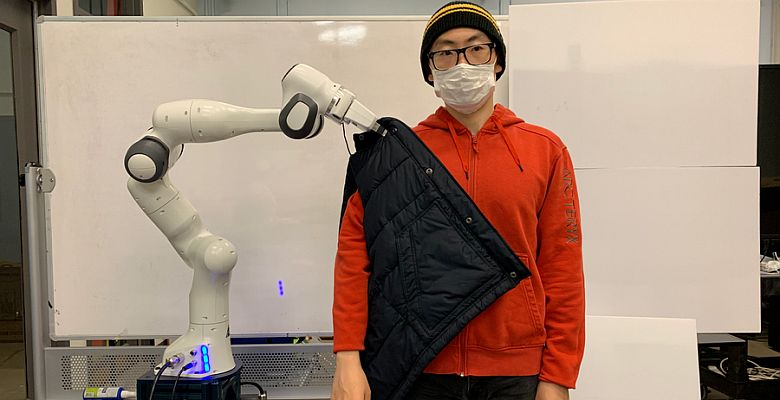

Robots hebben niet hetzelfde aangeboren gedragsbewustzijn en controle als de mens, dus een veilige samenwerking met mensen vereist methodische planning en coördinatie. Wetenschappers aan het Massachusetts Institute of Technology hebben een nieuw algoritme gecreëerd om een robot te helpen efficiënte bewegingsplannen te vinden. In dit geval hielp de bot een mens een jas aan te trekken, wat een krachtig hulpmiddel zou kunnen zijn bij voor hulp aan mensen met een handicap of beperkte mobiliteit.

Modellering, veiligheid en efficiëntie

Het ontwikkelen van algoritmes om fysieke schade te voorkomen zonder de efficiëntie van de taak onnodig te beïnvloeden, is een grote uitdaging. Door te zorgen dat robots geen schadelijke aanraking met mensen maken, kan de nieuwe methode efficiënte robottrajecten vinden om veilig een mens aan te kleden.

Correcte modellering van de mens - hoe hij beweegt en reageert - is noodzakelijk om succesvolle robotbewegingsplanning mogelijk te maken bij interactieve mens-robot taken. Een robot kan een vloeiende interactie tot stand brengen als het menselijke model perfect is. Wat niet het geval is.

Een robot die bijvoorbeeld bij iemand thuis wordt afgeleverd, zou een zeer beperkt 'standaard' model hebben van hoe een mens met de robot zou kunnen interageren tijdens een hulp- en aankleedtaak. Hij zou geen rekening houden met de grote variabiliteit in menselijke reacties. Deze zijn afhankelijk van talloze variabelen, zoals persoonlijkheid en gewoonten. Een schreeuwende peuter reageert anders op het aantrekken van een jas of shirt dan een kwetsbare oudere of mensen met een beperking.

Als die robot opdracht krijgt om de mens aan te kleden, plant hij een traject plant dat uitsluitend gebaseerd is op dat standaardmodel. Dan zou de robot onhandig tegen de mens aan kunnen botsen, met een ongemakkelijke ervaring of mogelijk zelfs letsel tot gevolg. Maar als hij te conservatief is bij het waarborgen van de veiligheid, kan hij aannemen dat zijn werkomgeving onveilig is. Dus hij 'bevriest'.

Onzekerheid

Om een theoretische garantie van menselijke veiligheid te bieden, redeneert het algoritme van het team over de onzekerheid in het menselijke model. In plaats van één standaardmodel, waarbij de robot slechts één potentiële reactie begrijpt, gaf het team de machine een begrip van vele mogelijke modellen. Hiermee is beter na te bootsen hoe een mens andere mensen kan begrijpen. Naarmate de robot meer gegevens verzamelt, zal hij de onzekerheid verminderen en de modellen verfijnen.

Om het probleem van de bevriezende robot op te lossen, herdefinieerde het team veiligheid voor mensbewuste bewegingsplanners. Hierbij valt te denken aan het vermijden van botsingen of het veilig neerkomen bij een botsing. Vooral bij door een robot ondersteunde activiteiten in het dagelijks leven kunnen botsingen niet volledig worden vermeden. Hierdoor kan de robot niet-schadelijk contact maken met de mens, zolang de impact maar gering is. Met deze tweeledige definitie van veiligheid kon de robot de aankleedtaak in een kortere tijd veilig afronden.

Het uiteindelijk doel is, robots in staat te stellen veiliger fysieke hulp te bieden aan mensen met een beperking.

Foto: MIT CSail