Een in Australië ontwikkeld algoritme kan een 'man in the middle' cyberaanval op een militaire robot onderscheppen en uitschakelen.

Australische onderzoekers hebben een algoritme ontworpen dat een 'man in the middle' cyberaanval op een militaire robot kan onderscheppen en binnen enkele seconden kan uitschakelen. In een experiment werden deep learning neurale netwerken gebruikt om het gedrag van het menselijk brein te simuleren. De onderzoekers zijn verbonden aan de Charles Sturt University (met hoofdvestiging in Bathurst, 200 km westelijk van Sydney) en de University of South Australia (UniSA) in Adelaide.

Algoritme

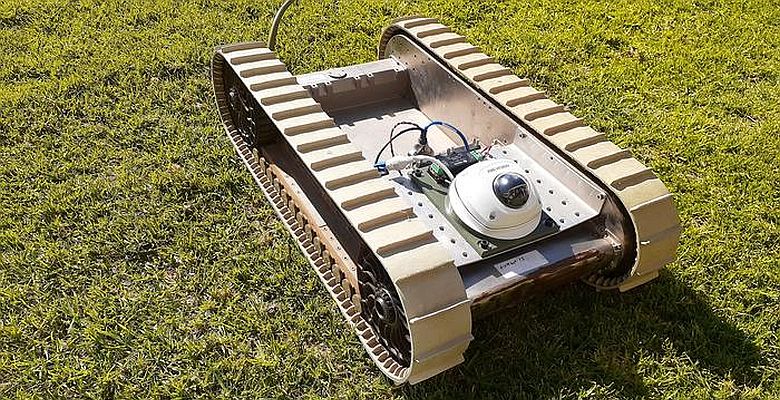

Experts op het gebied van kunstmatige intelligentie (AI) hebben het besturingssysteem van de robot getraind om de handtekening van een MitM-afluisterende cyberaanval te leren. Dit is waar aanvallers een bestaand gesprek of gegevensoverdracht onderbreken. Doel was een 'man in the middle' cyberaanval op een GVT-BOT voertuig te repliceren. De onderzoekers trainden het besturingssysteem om een aanval te herkennen.

Het algoritme werd in real-time getest op een replica van een gevechtsvoertuig van het Amerikaanse leger. Het was voor 99% succesvol in het voorkomen van een kwaadaardige aanval. Fout-positieve percentages van minder dan 2% valideerden het systeem, wat de effectiviteit ervan aantoonde. Volgens de onderzoekers presteert het voorgestelde algoritme daarmee beter dan andere herkenningstechnieken die over de hele wereld worden gebruikt om cyberaanvallen te detecteren.

Kwetsbaarheid

Industrie 4.0 wordt gekenmerkt door de evolutie in robotica, automatisering en het Internet of Thins (IoT). Dit vereist dat robots samenwerken, waarbij sensoren, actuatoren en controllers via clouddiensten met elkaar moeten communiceren en informatie moeten uitwisselen. Het nadeel hiervan is dat het hen kwetsbaar maakt voor cyberaanvallen. Een robotbesturingssysteem (ROS) is gevoelig voor datalekken en elektronische kaping, omdat het zo sterk met netwerken verbonden is.

Het goede nieuws is dat de computersnelheid elke paar jaar verdubbelt. Het is mogelijk om geavanceerde AI-algoritmen te ontwikkelen en te implementeren om systemen te beschermen tegen digitale aanvallen. Ondanks de grote voordelen en het wijdverbreide gebruik negeert een robotbesturingssysteem grotendeels beveiligingsproblemen in zijn coderingsschema door gecodeerde netwerkverkeersgegevens en beperkte mogelijkheden voor integriteitscontrole.

Dankzij deep learning is het in Australië ontwikkelde raamwerk voor inbraakdetectie robuust en nauwkeurig. Het systeem kan grote datasets verwerken die geschikt zijn om grootschalige en real-time datagestuurde systemen zoals ROS te beveiligen. De onderzoekers willen hun inbraakdetectie-algoritme testen op verschillende robotplatforms, zoals drones. De dynamiek hiervan is sneller en complexer dan die van een robot die aan de grond blijft.

De wetenschappelijke publicatie vindt u hier.

Foto: Fendy Santoso, Charles Sturt Universiteit